يفتح الذكاء الاصطناعي إمكانيات لا حصر لها. بالنسبة لفرق الموارد البشرية، يمكن أن يبسط ذلك الامتثال العالمي. ولكن خطوة واحدة خاطئة، ويمكنك أن تجد نفسك في نزاعات قانونية وسمعة سيئة.

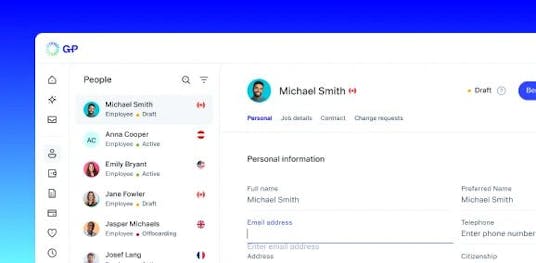

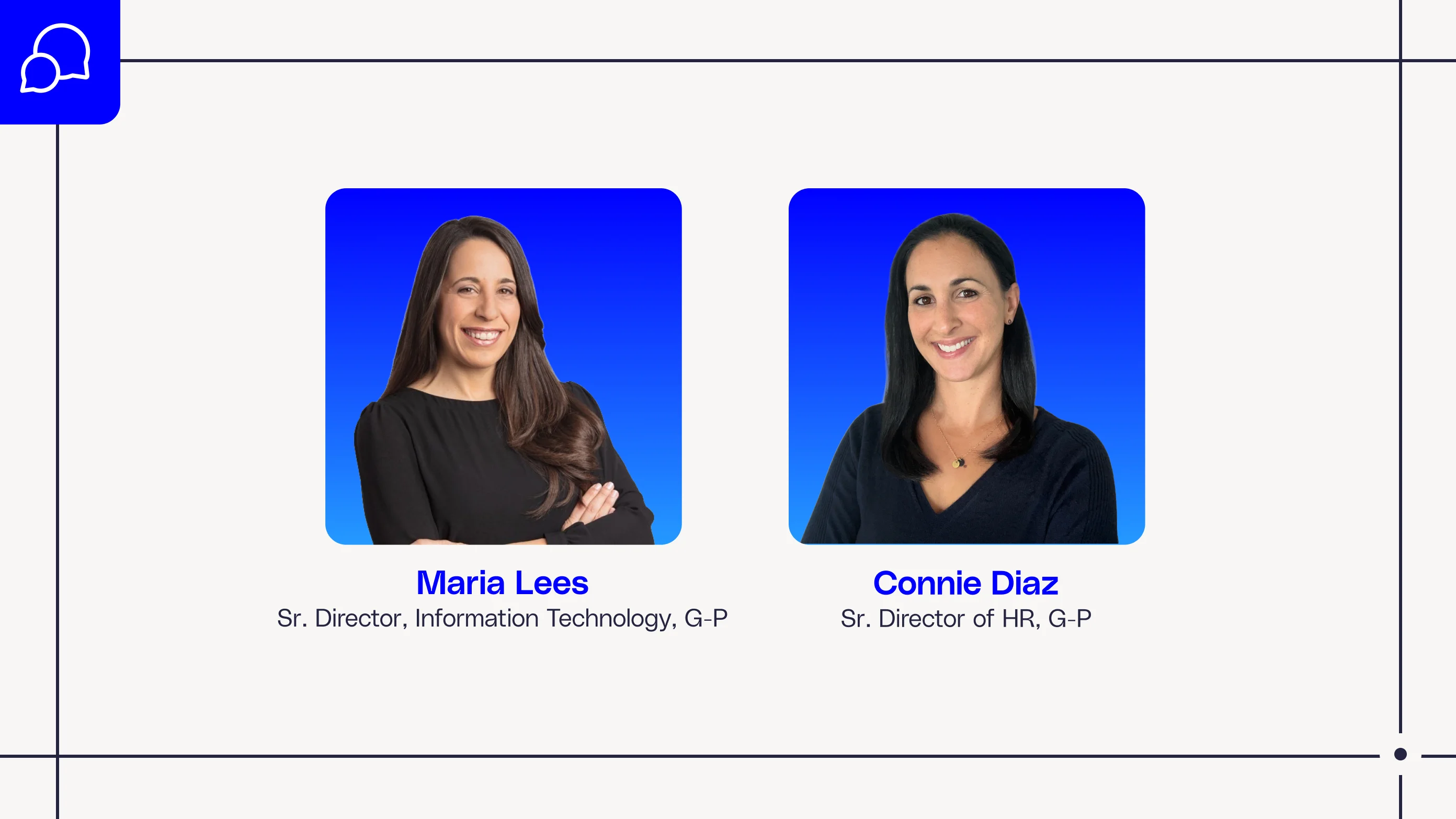

يُطلق قادة تكنولوجيا المعلومات في كل مكان أكمامهم ويتعاملون مع اعتماد الذكاء الاصطناعي مباشرةً. في ندوة حديثة عبر الإنترنت، شاركت ماريا ليز، المدير الأول لتكنولوجيا المعلومات في G-P، كيف يمكن لفرق الموارد البشرية دمج الذكاء الاصطناعي وتخفيف المخاوف بشأن أمن البيانات والتحيز والخصوصية.

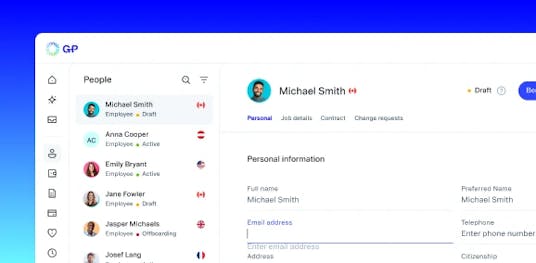

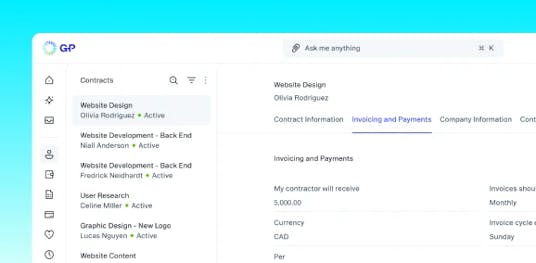

انضمت ليز إلى G-P في 2023، في الوقت الذي بدأنا فيه بناء وكيل الموارد البشرية العالمي المدعوم بالذكاء الاصطناعي، G-P Gia™. تعمل جيا كذكاء اصطناعي وكيل للموارد البشرية يمكنه خفض تكلفة ووقت الامتثال بنسبة تصل إلى 95%. لذلك تعرف لي شيئًا أو اثنين عن اعتماد الذكاء الاصطناعي، وهو ما تلخصه إلى شيء واحد حاسم: سلامة البيانات.

تقول لي: "لا يمكنك القفز على الخطوات الأساسية". "يتمثل جزء من دورنا كقادة لتكنولوجيا المعلومات في مساعدة القيادة على فهم هذه الرحلة. قد يطلب القائد أداة ذكاء اصطناعي وكيلة يمكنها اتخاذ قرارات معقدة بمفردها، وعلى الرغم من أن هذا هدف رائع وأنا أحبه، إلا أنه ليس بالضرورة أن يكون الوصول إلى هناك أمرًا واقعيًا دون هذا الأساس أولاً. ولبناء هذا الأساس، تتمثل الخطوة الأولى في بناء الثقة في بياناتك، ولا تكون بياناتك جيدة إلا بقدر المعلومات التي تقدمها. لذلك إذا كانت منعزلة، فهي غير دقيقة، أو فوضوية - فكل ما تبنيه فوق ذلك سيكون معيبًا تمامًا.

الثقة الهندسية: سد الفجوة بنسبة 3%

يؤمن ليس إيمانًا راسخًا "بالثقة من خلال الشفافية". في عصر الذكاء الاصطناعي، يجب أن ترتكز الشركات على هذا الشعار وأن تكون على استعداد لإظهار المصادر وشرح "السبب" وراء أي توصية بالذكاء الاصطناعي. هذا هو أساس مصداقية المنتج وثقة المستخدم.

يوضح ليس قائلاً: "الثقة والشفافية أمران نأخذهما بعين الاعتبار عندما بنينا الذكاء الاصطناعي الخاص بنا". "كنا نعلم أنه لكي يثق أي شخص في إجابات جيا، يجب أن يثق في أساسها. وهي مبنية على الكثير من الخبرة، عقد من الخبرة العالمية الخاصة بـ G-P. معرفتها ليست عشوائية. وهو يتضمن مليون سيناريو من واقع الحياة وأكثر من 100,000 مقالة وبيانات تم فحصها قانونًا من أكثر من 1,500 مصدر حكومي.

عندما يطرح المستخدمون على جيا سؤالاً، يكون الناتج دائمًا مصحوبًا بمصادر مؤكدة من G-P، مما يعني أن خبراء G-P قد تحققوا من صحة المعلومات. تم تصميم Gia بدقة لا مثيل لها، والمنتج النهائي هو الذكاء الاصطناعي المعلق ببراءة اختراع مع نموذج RAG مسجل الملكية الذي يحقق نتائج أفضل 10 مرات من معيار صناعة الذكاء الاصطناعي.

على الرغم من التطورات الواضحة في الذكاء الاصطناعي، لا يزال اكتساب الثقة على مستوى الشركة في الأدوات يمثل تحديًا مستمرًا للعديد من قادة تقنية المعلومات. كشف 2025تقرير World at Work أن 3% فقط من المسؤولين التنفيذيين سيثقون في الذكاء الاصطناعي لاتخاذ أي قرار. تحتاج أقسام تكنولوجيا المعلومات إلى مساعدة القادة على الشعور بالراحة في تبني تقنيات الذكاء الاصطناعي.

بعبارة ليز: "هذه النسبة 3% تعني حقًا، وهذا منطقي تمامًا الآن. هناك الكثير من المجهولات. وهناك نقص في المعرفة والفهم، والجميع في سباق للوصول إلى مكان ما. لكنها تسلط الضوء حقًا على فجوة الثقة الطبيعية. ويُظهر أن التحدي الذي نواجهه كقادة لا يتعلق فقط بتنفيذ التكنولوجيا، بل يتعلق أيضًا ببناء الثقة فيها. لذا فإن نصيحتي هي أن تفكر في الأمر كعضو جديد وذكي للغاية في الفريق. يجب عليك بناء الثقة بشكل متزايد.

إطار عمل التحقق من صحة الإنسان داخل الحلقة

لا يتم إنشاء جميع أدوات الذكاء الاصطناعي بالتساوي. ولا يمكن للجميع بناء حلولهم الخاصة، لذلك تحتاج الشركات إلى عملية تدقيق قوية لأدوات الطرف الثالث. إذن، كيف يمكن لفرق تكنولوجيا المعلومات تقييم أدوات الذكاء الاصطناعي قبل طرحها؟ يقول ليز: "يصل هذا السؤال حقًا إلى جوهر فلسفتنا هنا في G-P".

تستخدم ليز علاقة عملها مع كوني دياز، مدير أول الموارد البشرية في G-P، لعرض كيفية تقديم فرق تكنولوجيا المعلومات لتكنولوجيا الذكاء الاصطناعي الجديدة لشركتهم. "لذا عندما يرغب أي فريق، وخاصة الموارد البشرية، في تبني أداة جديدة، فإن دور [تكنولوجيا المعلومات] لفريقي لا يجب أن يكون حارس بوابة في نهاية العملية. من الأفضل أن تكون شريكًا استراتيجيًا منذ البداية. إنه تعاون حقيقي متعدد الوظائف نقبله".

تتبع تكنولوجيا المعلومات نهجًا بشريًا في الحلقة للتحقق من صحة كل أداة، حيث تضمن الخبرة متعددة الوظائف الامتثال والثقة. يقوم الفريق الفني بتقييم التوافق مع المعايير الهندسية، وتحليل تكنولوجيا المعلومات للمخاطر الأمنية، والمراجعات القانونية للامتثال العالمي، ويضمن مجلس الذكاء الاصطناعي مواءمة الحوكمة، ويقدم قسم الموارد البشرية الحالة التجارية والأخلاقية المهمة.

ووافقت دياز قائلة: "إن النظر إلى هذا الأمر كجهد مشترك يساعد على بناء أساس الثقة". "لذلك، بصفتك صاحب عمل أو مسؤولًا تنفيذيًا، فإن أداة الذكاء الاصطناعي مثل جيا ليست مجرد صندوق أسود، بل هي أداة يشرف عليها خبراء الموارد البشرية وتكنولوجيا المعلومات بفعالية وشفافية. من المرجح أن يثق الناس كثيرًا في المخرجات التي يحصلون عليها منها".

تُوفّر الموارد البشرية ضمانًا باستخدام الأداة بشكل أخلاقي وعادل، بينما تُوفّر تكنولوجيا المعلومات الثقة في أنّها آمنة ومتوافقة. إنها مسؤولية مشتركة تُظهر الالتزام تجاه كل من الأشخاص ونزاهة البيانات.

ابدأ بمصدر بيانات نظيف

يمكن أن يستغرق الجدول الزمني لطرح أداة الذكاء الاصطناعي الجديدة من أسابيع إلى أشهر. يعتمد هذا على ما إذا كانت لديك بيانات جاهزة على الفور للاستخدام في نموذج الذكاء الاصطناعي أو أن بياناتك غير كاملة ومخزنة في تنسيقات غير متوافقة والتي ستحتاج تكنولوجيا المعلومات إلى استخراجها. توصي Lees بالبدء بصغر الحجم. "لا تحاول غلي المحيط. ما عليك سوى اختيار مكان واحد يمكنك التعامل معه وتحقيق فوز سريع من ذلك. ابدأ في بناء زخمك من هناك".

تدور الأسئلة الكبيرة بشكل عام حول خصوصية البيانات.

أولاً: هل يمكن استخدام بيانات الشركة لتدريب نموذج الذكاء الاصطناعي؟

ثانيًا: كيف يمكن لقسم تكنولوجيا المعلومات وضع ضوابط وصول صارمة بحيث يرى الأشخاص المناسبون فقط المعلومات الصحيحة؟

نظرًا لأننا نعالج كل هذه المشكلات الحرجة بشكل جماعي ومسبق، فإن المحادثة لا تتعلق بإدراج المشكلات. الأمر يتعلق بإيجاد الحلول الفعلية". عندما نتبع هذه العملية، يكون ذلك مربحًا للجميع. يمكننا أن نعتمد بثقة أداة الذكاء الاصطناعي التي ستساعد الشركة... إنها عملية قد ينظر إليها المرء على أنها عائق، ولكننا حولنا ذلك إلى شراكة قوية للتأكد من أننا نحمي G-P وبياناتنا.

تكنولوجيا المعلومات والموارد البشرية: الشركاء في جاهزية البيانات

وبالنسبة للفرق التي بدأت رحلتها في الذكاء الاصطناعي، أكد لي على أهمية الإعداد. سيؤدي اختيار نموذج الذكاء الاصطناعي على البيانات غير المكتملة إلى مخرجات سيئة تضر بالثقة التي تحاول بناءها في مؤسستك. نصيحة لي هي أنه قبل أن يختار الفريق أداة، يجب أن يكون أساس البيانات هو نقطة التفتيش الأولى. وهنا تصبح الشراكة الوثيقة بين الموارد البشرية وتكنولوجيا المعلومات مهمة للغاية.

أولاً، يمكن لقسم تكنولوجيا المعلومات مساعدة الموارد البشرية عن طريق تنظيف البيانات ومركزتها. وهذا يعني دمج المعلومات من الأنظمة المختلفة، مثل كشوف الرواتب والمزايا ومراجعات الأداء، في مصدر واحد. بعد ذلك، يمكن لقسم تكنولوجيا المعلومات مساعدة الموارد البشرية على وضع حوكمة للبيانات ووضع ضوابط وصول قوية لحماية معلومات الموظفين الحساسة.

يُعد وضع قواعد واضحة لكيفية جمع البيانات واستخدامها أمرًا بالغ الأهمية للدقة والخصوصية.

خفض تكاليف ووقت الامتثال بنسبة تصل إلى 95% مع جيا

لا تدع عقبات الامتثال تبطئ من عمل فريق الموارد البشرية. يمكن لأداة الذكاء الاصطناعي التي يتم فحصها من قِبل الخبراء تسريع الزخم وتلبية المعايير العالية لفريق تكنولوجيا المعلومات لديك فيما يتعلق بأمن البيانات والشفافية الأخلاقية والامتثال الذي يمكن التحقق منه. جيا هي تلك الأداة.

اعترف مسؤول الموارد البشرية التنفيذي بجيا كأفضل منتج للموارد البشرية لعام 2025. إنه الذكاء الاصطناعي الوكيلي المصمم لتبسيط الموارد البشرية العالمية من خلال الإجابة عن أصعب أسئلة الامتثال عبر 50 دولة وجميع 50 الولايات الأمريكية.

لا توجد عقبات أخرى أمام المستشار القانوني أو ساعات مكلفة واجبة الدفع. مع جيا، أصبح الامتثال العالمي سهلاً. هل ترغب في تبسيط الموارد البشرية العالمية من خلال إرشادات تم فحصها من قبل خبراء يمكنك الوثوق بها؟ اشترك للحصول على نسخة تجريبية مجانية اليوم.

لمعرفة المزيد من ماريا ليز حول كيفية تعاون تكنولوجيا المعلومات بنجاح مع الموارد البشرية، شاهد مناقشتها الكاملة مع زميلتها كوني دياز.