L’IA apre infinite possibilità. Per i team HR, può semplificare la conformità globale. Ma un passo sbagliato e ci si può trovare in controversie legali e con una reputazione danneggiata.

I leader IT di tutto il mondo si rimboccano le maniche e affrontano l’adozione dell’IA a testa alta. In un recente webinar, Maria Lees, Senior Director of IT di G-P, ha condiviso come i team delle Risorse Umane possono integrare l’IA e alleviare le preoccupazioni sulla sicurezza dei dati, i pregiudizi e la privacy.

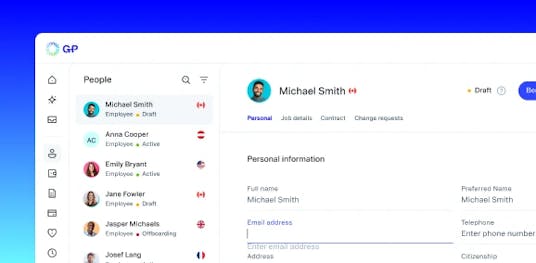

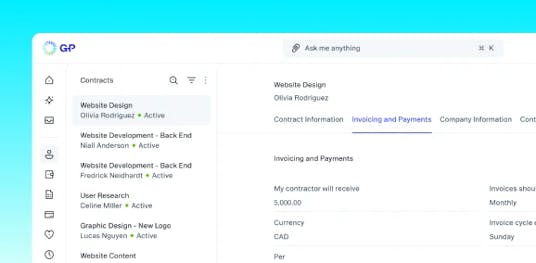

Lees è entrata a far parte di G-P nel 2023, proprio nel periodo in cui abbiamo iniziato a costruire il nostro agente HR globale basato sull’intelligenza artificiale, G-P Gia™. Gia è un'intelligenza artificiale per le risorse umane che può ridurre i costi e i tempi di conformità fino al 95%. Quindi Lees sa una cosa o due sull'adozione dell'IA, che si riduce a una cosa cruciale: l'integrità dei dati.

“Non puoi saltare i passi fondamentali”, dice Lees. “Parte del nostro ruolo di leader IT è aiutare la leadership a comprendere questo percorso. Un leader potrebbe chiedere uno strumento di intelligenza artificiale agente che possa prendere decisioni complesse da solo, e anche se questo è un grande obiettivo e lo amo, non è necessariamente realistico arrivarci senza quella base prima. E per costruire quella base, il primo passo è quello di stabilire la fiducia nei tuoi dati, e i tuoi dati sono buoni solo quanto le informazioni che li alimenti. Quindi, se è isolato, è impreciso, o è disordinato - qualunque cosa tu costruisca su questo sarà completamente imperfetta.”

Fiducia ingegneristica: colmare il divario del 3%

Lees crede fermamente nella “fiducia attraverso la trasparenza”. Nell’era dell’IA, le aziende devono essere ancorate da questo mantra ed essere disposte a mostrare le fonti e spiegare il “perché” dietro qualsiasi raccomandazione sull’IA. Questa è la base per la credibilità del prodotto e la fiducia degli utenti.

“La fiducia e la trasparenza sono qualcosa che abbiamo preso a cuore quando abbiamo costruito la nostra intelligenza artificiale”, spiega Lees. “Sapevamo che chiunque si fidasse delle risposte di Gia avrebbe dovuto fidarsi delle sue fondamenta. E si basa su una tonnellata di esperienza, un decennio di esperienza globale di G-P. La sua conoscenza non è casuale. Include un milione di scenari del mondo reale e oltre 100.000 articoli e dati legalmente controllati da oltre 1.500 fonti governative.

Quando gli utenti fanno una domanda a Gia, l'output è sempre accompagnato da fonti verificate da G-P, il che significa che gli esperti di G-P hanno convalidato le informazioni. Gia è costruita per una precisione senza pari e il prodotto finale è un'intelligenza artificiale in attesa di brevetto combinata con un modello RAG proprietario che offre risultati 10 volte migliori rispetto allo standard del settore dell'intelligenza artificiale.

Nonostante i chiari progressi nell'IA, ottenere la fiducia dell'intera azienda negli strumenti è ancora una sfida continua per molti leader IT. Il 2025 rapporto World at Work ha rivelato che solo il 3% dei dirigenti si fiderebbe dell’IA per prendere qualsiasi decisione. I reparti IT devono aiutare i leader a sentirsi a proprio agio nell’adottare tecnologie IA.

Nelle parole di Lees: “Quel 3% è davvero significativo, e ha perfettamente senso in questo momento. Ci sono molte incognite là fuori. E c'è una mancanza di conoscenza e comprensione, e tutti sono in corsa per arrivare da qualche parte. Ma mette davvero in evidenza un naturale divario di fiducia. E dimostra che la nostra sfida come leader non riguarda solo l'implementazione della tecnologia, ma piuttosto la costruzione della fiducia in essa. Quindi il mio consiglio è di pensarlo come un nuovo, incredibilmente intelligente membro del team. Bisogna costruire la fiducia in modo incrementale.”

Il framework di convalida umano-in-the-loop

Non tutti gli strumenti di intelligenza artificiale sono creati uguali. E non tutti possono costruire le proprie soluzioni, quindi le aziende hanno bisogno di un forte processo di verifica per strumenti di terze parti. Quindi, come possono i team IT valutare gli strumenti di IA prima di lanciarli? "Questa domanda arriva davvero al cuore della nostra filosofia qui a G-P", dice Lees.

Lees utilizza il suo rapporto di lavoro con Connie Diaz, Senior Director of HR di G-P, per mostrare come i team IT introducono la nuova tecnologia IA nella loro azienda. “Quindi, quando un team, in particolare le risorse umane, vuole adottare un nuovo strumento, il ruolo [IT] del mio team non è quello di essere un gatekeeper alla fine del processo. È più che altro essere un partner strategico fin dall’inizio. È una vera collaborazione interfunzionale che adottiamo”, afferma.

L’IT adotta un approccio umano-in-the-loop per convalidare ogni strumento, in cui l’esperienza interfunzionale garantisce conformità e sicurezza. Il team tecnico valuta l’allineamento con gli standard ingegneristici, l’IT analizza i rischi per la sicurezza, le revisioni legali per la conformità globale, il consiglio di IA garantisce l’allineamento della governance e le Risorse umane forniscono il caso aziendale ed etico critico.

“Guardare a questo come uno sforzo congiunto aiuta a costruire quel fondamento di fiducia”, concorda Diaz. Quindi, come datore di lavoro o come dirigente, uno strumento di intelligenza artificiale come Gia non è solo una scatola nera, è uno strumento che è supervisionato attivamente e in modo trasparente sia da esperti di risorse umane che IT. Le persone sono molto più propense a fidarsi dei risultati che stanno ottenendo da esso.”

Le Risorse Umane garantiscono che lo strumento sia utilizzato in modo etico e corretto, mentre l’IT dà la certezza che sia sicuro e conforme. È una responsabilità condivisa che dimostra un impegno sia nei confronti delle persone che dell’integrità dei dati.

Inizia con un'origine dati pulita

La tempistica per implementare un nuovo strumento di IA può richiedere da settimane a mesi. Ciò dipende dal fatto che i dati siano immediatamente pronti per l'uso in un modello di IA o che i dati siano incompleti e archiviati in formati incompatibili che l'IT dovrà estrarre. Lees consiglia di iniziare in piccolo. “Non cercare di far bollire l’oceano. Basta scegliere un punto che si può affrontare e ottenere una rapida vittoria da questo. Inizia a costruire il tuo slancio da lì”, dice.

Le grandi domande riguardano generalmente la privacy dei dati.

Primo: i dati dell'azienda possono essere utilizzati per addestrare il modello di IA?

Secondo: come può l’IT impostare severi controlli di accesso in modo che solo le persone giuste vedano le informazioni giuste?

"Poiché stiamo affrontando tutti questi problemi critici collettivamente e in anticipo, la conversazione non riguarda l'elenco dei problemi. Si tratta di trovare le soluzioni reali”, dice Lees. “Quando seguiamo questo processo, è un vantaggio per tutti. Possiamo approvare con fiducia uno strumento di intelligenza artificiale che aiuterà l'azienda ... è un processo che si potrebbe considerare un ostacolo, ma lo abbiamo trasformato in una solida partnership per assicurarci di proteggere G-P e i nostri dati "

IT e HR: partner nella preparazione dei dati

Per i team che iniziano il loro percorso di intelligenza artificiale, Lees ha sottolineato l’importanza della preparazione. La scelta di un modello di intelligenza artificiale su dati incompleti comporterà risultati negativi che danneggeranno la fiducia che stai cercando di costruire nella tua organizzazione. Il consiglio di Lees è che prima che un team selezioni uno strumento, la base dati deve essere il primo punto di controllo. Ed è qui che diventa così importante una stretta collaborazione tra HR e IT.

In primo luogo, l’IT può aiutare le Risorse Umane a pulire e centralizzare i dati. Ciò significa consolidare le informazioni provenienti da diversi sistemi, come buste paga, benefit e revisioni delle prestazioni, in un'unica fonte. Successivamente, l’IT può aiutare le Risorse umane a stabilire la governance dei dati e a mettere in atto controlli di accesso rigorosi per proteggere le informazioni sensibili dei dipendenti.

La creazione di regole chiare per il modo in cui i dati vengono raccolti e utilizzati è fondamentale per l'accuratezza e la privacy.

Riduci i costi e i tempi di conformità fino al 95% con Gia

Non lasciare che gli ostacoli alla conformità rallentino il tuo team delle Risorse Umane. Uno strumento di intelligenza artificiale testato da esperti può accelerare lo slancio e soddisfare l'elevato livello di sicurezza dei dati, trasparenza etica e conformità verificabile del tuo team IT. Gia è questo strumento.

Gia è stata riconosciuta come Top HR Product del 202025 dall’HR Executive. Si tratta di un’intelligenza artificiale agentica progettata per semplificare le risorse umane globali rispondendo alle tue domande di conformità più difficili in 50 paesi e in tutti gli 50 stati degli Stati Uniti.

Niente più ostacoli legali o costose ore fatturabili. Con Gia, la conformità globale è facile. Vuoi semplificare le risorse umane globali con una guida di esperti di cui ti puoi fidare? Iscriviti oggi stesso per una prova gratuita.

Per saperne di più da Maria Lees su come l’IT può collaborare con successo con le Risorse umane, guarda la sua discussione completa con la collega Connie Diaz.