AI öppnar oändliga möjligheter. För HR-team kan det förenkla global efterlevnad. Men ett felsteg och du kan hitta dig själv i rättsliga tvister och ett skadat rykte.

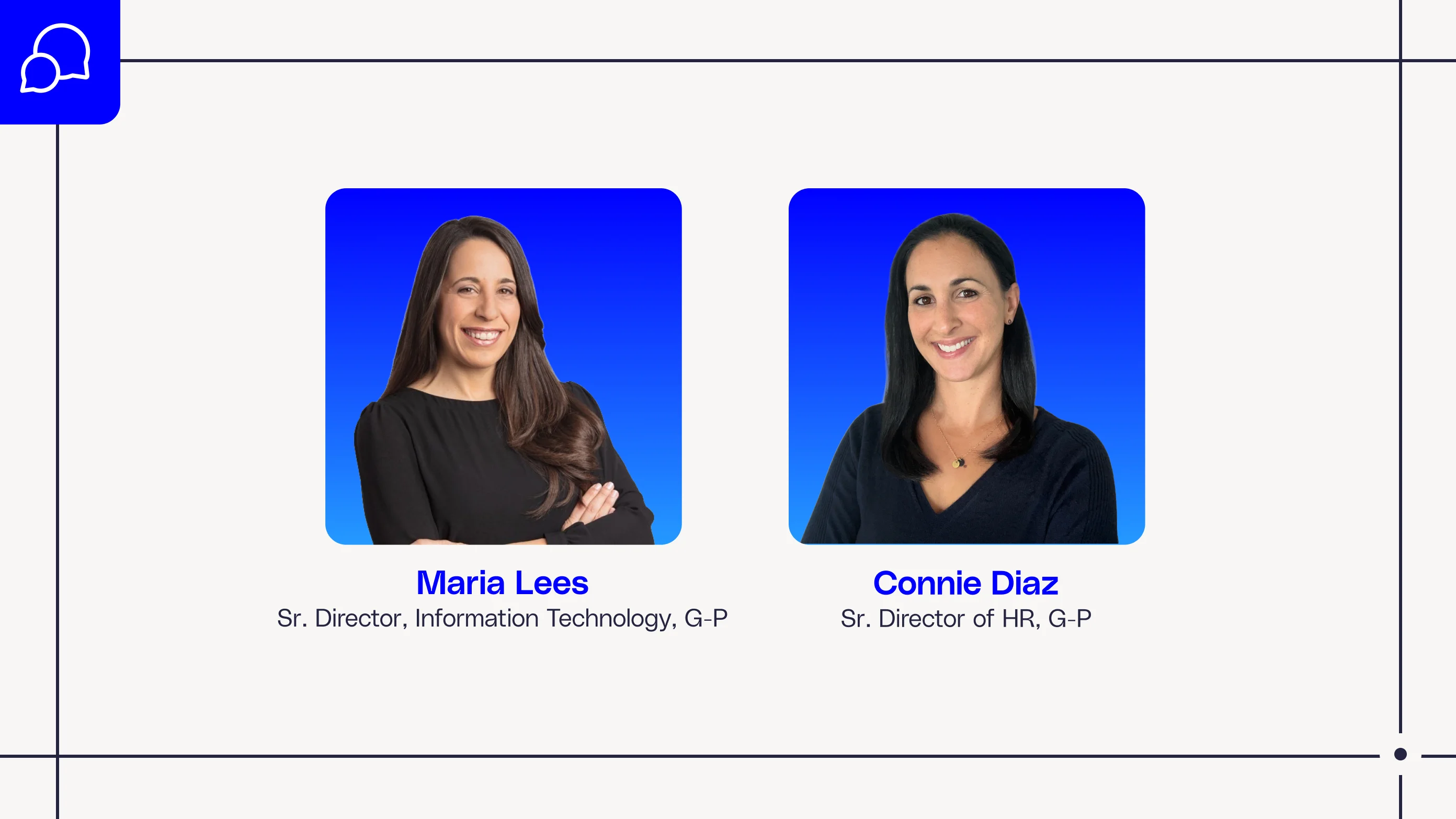

IT-ledare överallt kavlar upp ärmarna och tacklar AI-antagandet. I ett nyligen genomfört webbseminarium berättade Maria Lees, Senior Director of IT på G-P, hur HR-team kan integrera AI och lindra oro över datasäkerhet, partiskhet och integritet.

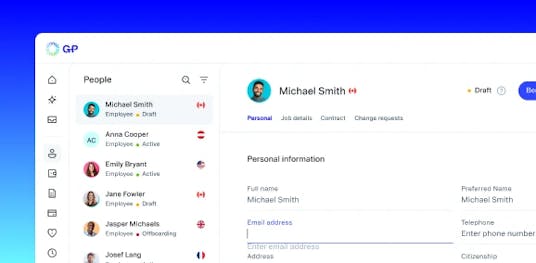

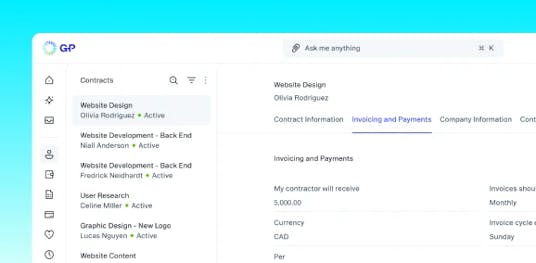

Lees började på G-P 2023, precis när vi började bygga vår AI-drivna globala HR-agent, G-P Gia™. Gia är agentisk AI för HR som kan minska kostnader och tid för efterlevnad med upp till 95%. Så Lees vet en sak eller två om AI-adoption, som hon kokar ner till en viktig sak: dataintegritet.

"Du kan inte hoppa över grundläggande steg", säger Lees. ”En del av vår roll som IT-ledare är att hjälpa ledningen att förstå denna resa. En ledare kan be om ett agentiskt AI-verktyg som kan fatta komplexa beslut på egen hand, och även om det är ett bra mål och jag älskar det, är det inte nödvändigtvis realistiskt att komma dit utan den grunden först. Och för att bygga den grunden är det första steget att skapa förtroende för dina data, och dina data är bara lika bra som den information du matar den. Så om det är siloed, det är felaktigt, eller det är rörigt - vad du bygger på det kommer att bli helt bristfälligt."

Tekniskt förtroende: överbrygga klyftan på 3 %

Lees tror starkt på ”tillit genom transparens”. I AI-eran måste företag förankras av detta mantra och vara villiga att visa källorna och förklara "varför" bakom någon AI-rekommendation. Detta är grunden för produktens trovärdighet och användarnas förtroende.

– Förtroende och transparens är något vi tog till oss när vi byggde vår egen AI, förklarar Lees. Vi visste att för att någon skulle lita på Gias svar, måste de lita på dess grund. Och den bygger på massor av erfarenhet, ett decennium av G-P:s egen globala expertis. Kunskapen är inte slumpmässig. Den innehåller en miljon verkliga scenarier och över 100,000 lagligt granskade artiklar och data från över 1,500 statliga källor.

När användare ställer en fråga till Gia åtföljs resultatet alltid av G-P-verifierade källor, vilket innebär att G-P-experter har validerat informationen. Gia är byggd för oöverträffad precision och slutprodukten är patentsökt AI i kombination med en patentskyddad RAG-modell som levererar resultat som är 10x bättre än AI-branschstandarden.

Trots de tydliga framstegen inom AI är det fortfarande en utmaning för många IT-ledare att få företagsomfattande förtroende för verktygen. World at Work-rapporten 2025 visade att endast 3 % av cheferna skulle lita på att AI fattar något beslut. IT-avdelningar måste hjälpa ledare att känna sig bekväma med att använda AI-teknik.

Med Lees ord: "Den 3% är verkligen berättande, och det är helt logiskt just nu. Det finns många okända där ute. Och det finns en brist på kunskap och förståelse, och alla är i ett lopp för att komma någonstans. Men det belyser verkligen en naturlig förtroendeklyfta. Och det visar att vår utmaning som ledare inte bara handlar om att implementera teknik, utan snarare om att bygga upp förtroendet för den. Så mitt råd är att tänka på det som en ny, otroligt smart teammedlem. Du måste bygga upp förtroende stegvis.”

Valideringsramverket för människa-i-slingan

Alla AI-verktyg är inte skapade lika. Och inte alla kan bygga sina egna lösningar, så företag behöver en stark granskningsprocess för tredjepartsverktyg. Så hur kan IT-team utvärdera AI-verktyg innan de rullar ut dem? "Denna fråga kommer verkligen till hjärtat av vår filosofi här på G-P", säger Lees.

Lees använder sin arbetsrelation med Connie Diaz, Senior Director of HR på G-P, för att visa hur IT-team introducerar ny AI-teknik för sitt företag. Så när något team, särskilt HR, vill anta ett nytt verktyg, är mitt teams [IT] roll inte att vara en gatekeeper i slutet av processen. Det är mer att vara en strategisk partner från början. Det är ett verkligt tvärfunktionellt samarbete som vi tar oss an, säger hon.

IT använder en människa-i-slingan strategi för att validera varje verktyg, där tvärfunktionell expertis säkerställer efterlevnad och förtroende. Det tekniska teamet bedömer anpassning till tekniska standarder, IT analyserar säkerhetsrisker, juridiska granskningar för global efterlevnad, AI-rådet garanterar styrningsanpassning och HR ger det kritiska affärs- och etiska fallet.

"Att se detta som en gemensam insats hjälper till att bygga den grunden för förtroende", håller Diaz med. – Så som arbetsgivare eller chef är ett AI-verktyg som Gia inte bara en svart låda, det är ett verktyg som aktivt och transparent övervakas av både HR- och IT-experter. Människor är mycket mer benägna att lita på de resultat som de får från det."

HR försäkrar att verktyget används etiskt och rättvist, medan IT ger förtroendet för att det är säkert och uppfyller kraven. Det är ett delat ansvar som visar ett engagemang för både människor och dataintegritet.

Börja med en ren datakälla

Tidslinjen för att lansera ett nytt AI-verktyg kan ta allt från veckor till månader. Detta beror på om du har data som är omedelbart redo att användas i en AI-modell eller om dina data är ofullständiga och lagras i inkompatibla format som IT behöver extrahera. Lees rekommenderar att man börjar smått. ”Försök inte koka havet. Välj bara en plats som du kan ta itu med och få en snabb vinst av det. Börja bygga upp din drivkraft därifrån”, säger hon.

De stora frågorna handlar i allmänhet om datasekretess.

Först: Kan företagets data användas för att träna AI-modellen?

För det andra: Hur kan IT upprätta strikta åtkomstkontroller så att endast rätt personer ser rätt information?

Eftersom vi tar itu med alla dessa kritiska frågor kollektivt och på förhand handlar samtalet inte om att lista problem. Det handlar om att hitta de faktiska lösningarna, säger Lees. – När vi följer den här processen är det en win-win för alla. Vi kan med säkerhet godkänna ett AI-verktyg som kommer att hjälpa verksamheten ... det är en process som man kan se som ett hinder, men vi har förvandlat det till ett starkt partnerskap för att se till att vi skyddar G-P och våra data.

IT och HR: partner i databeredskap

För team som börjar sin AI-resa betonade Lees vikten av förberedelse. Att välja en AI-modell på ofullständiga data kommer att resultera i dåliga resultat som skadar det förtroende du försöker bygga i din organisation. Lees råd är att innan ett team väljer ett verktyg måste datafundamentet vara den första kontrollpunkten. Och det är där ett nära samarbete mellan HR och IT blir så viktigt.

För det första kan IT hjälpa HR genom att rensa och centralisera data. Detta innebär att konsolidera information från olika system, såsom löner, förmåner och prestationsgranskningar, till en enda källa. Därefter kan IT hjälpa HR att etablera datastyrning och införa starka åtkomstkontroller för att skydda känslig information om anställda.

Att skapa tydliga regler för hur data samlas in och används är avgörande för noggrannhet och integritet.

Minska efterlevnadskostnader och -tid med upp till 95% med Gia

Låt inte efterlevnadshinder bromsa ditt HR-team. Ett expertgranskat AI-verktyg kan accelerera farten och möta IT-teamets höga nivå för datasäkerhet, etisk transparens och verifierbar efterlevnad. Gia är det verktyget.

Gia utsågs till en av de främsta HR-produkterna 2025 av HR Executive. Det är agentisk AI utformad för att effektivisera global HR genom att svara på dina tuffaste efterlevnadsfrågor i 50 länder och alla 50 amerikanska stater.

Inga fler juridiska rådgivare hinder eller kostsamma faktureringsbara timmar. Med Gia är global efterlevnad enkel. Vill du förenkla global HR med expertgranskad vägledning som du kan lita på? Registrera dig för en gratis provperiod idag.

För att lära dig mer från Maria Lees om hur IT kan samarbeta framgångsrikt med HR, titta på hennes fullständiga diskussion med kollegan Connie Diaz.